Rapid-MLX是专为苹果硅芯片(M1/M2/M3/M4)优化的本地AI推理引擎,速度极快(自称比Ollama快4.2倍)。它允许用户在Mac上离线运行大型语言模型,无需云端API费用。可作为OpenAI API的替代品,兼容Cursor、Claude Code等开发工具,支持工具调用、提示缓存和模型路由。

LangHire是一个基于AI的自动化求职申请系统,通过本地运行的桌面应用自动搜索LinkedIn职位、填写申请表、上传简历并提交。其核心特点是具备自学习记忆引擎,能记住不同招聘系统的操作模式,从而随时间推移提高申请效率和准确性。

这是一个用于维护Codex AI助手本地状态的Python工具。它帮助用户在清理和优化Codex本地数据(如聊天记录、终端会话、工作树等)时,先进行安全备份和交接文档创建,避免数据丢失。支持检测占用情况、归档旧聊天记录、清理冗余文件等操作,确保Codex保持快速运行。

这是一个Manim插件,专门用于创建电子电路动画。支持绘制原理图,并动画展示电流流动、信号传播和元件行为,主要面向电子爱好者和学生进行教学演示。

Kwipu是一个完全本地化的Graph RAG系统,可将Markdown笔记转换为可查询的知识图谱。它基于自然语言提问,从多文件中关联信息提供答案。专为Obsidian库设计,也可处理任何Markdown文件夹。通过混合检索(向量+BM25+时序)提取wikilink和YAML前端的实体关系三元组,支持多语言,无需云端,运行在Ollama上。

这是一个基于LangGraph和Tavily的多智能体公司深度研究工具,能自动从多源收集信息,生成全面的公司研究报告。后端利用Gemini和GPT模型进行分析推理,前端提供现代化网页界面。

这是一个基于Docker的Telegram机器人容器项目,通过Docker Compose部署,可配置AI代理(如Google Gemini模型)实现自动化对话功能,支持文件挂载配置和可选的GPU加速。

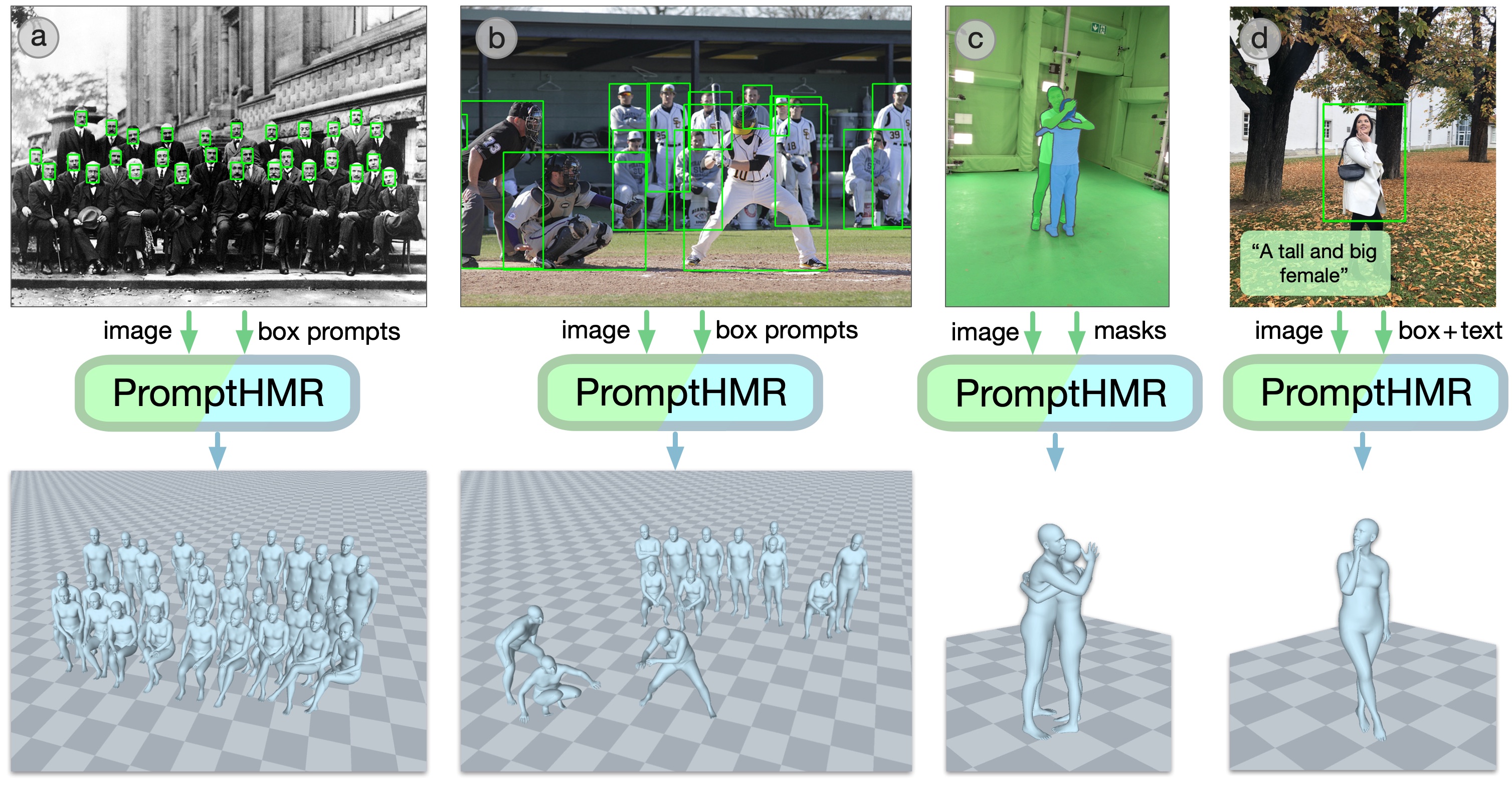

PromptHMR是一个基于提示词的可控人体三维网格重建工具,通过自然语言描述即可精确调整重建效果。支持从图像或视频中恢复带关节姿态和形状的三维人体模型,主要用于计算机视觉和图形学领域的研究与应用。

Neuracore是一个强大的机器人学习平台,提供数据收集与可视化、模型训练、部署以及实时推理等功能,支持自定义数据类型,旨在简化机器人学习流程。

Lens是一个自托管的多供应商LLM网关与管理后台,旨在统一分散的模型服务(如OpenAI、Anthropic、Gemini等)。它提供一个统一的API入口和网关密钥,支持多协议接口、上游渠道管理、故障切换、请求监控和成本估算,适合个人或团队简化LLM集成。

这是一个为ClaudeCode设计的iOS模拟器技能工具包,提供Xcode构建和iOS模拟器自动化功能,包括编译、测试、语义化UI导航等22个优化脚本,主要用于提升AI代理和开发者的iOS应用开发和测试效率。

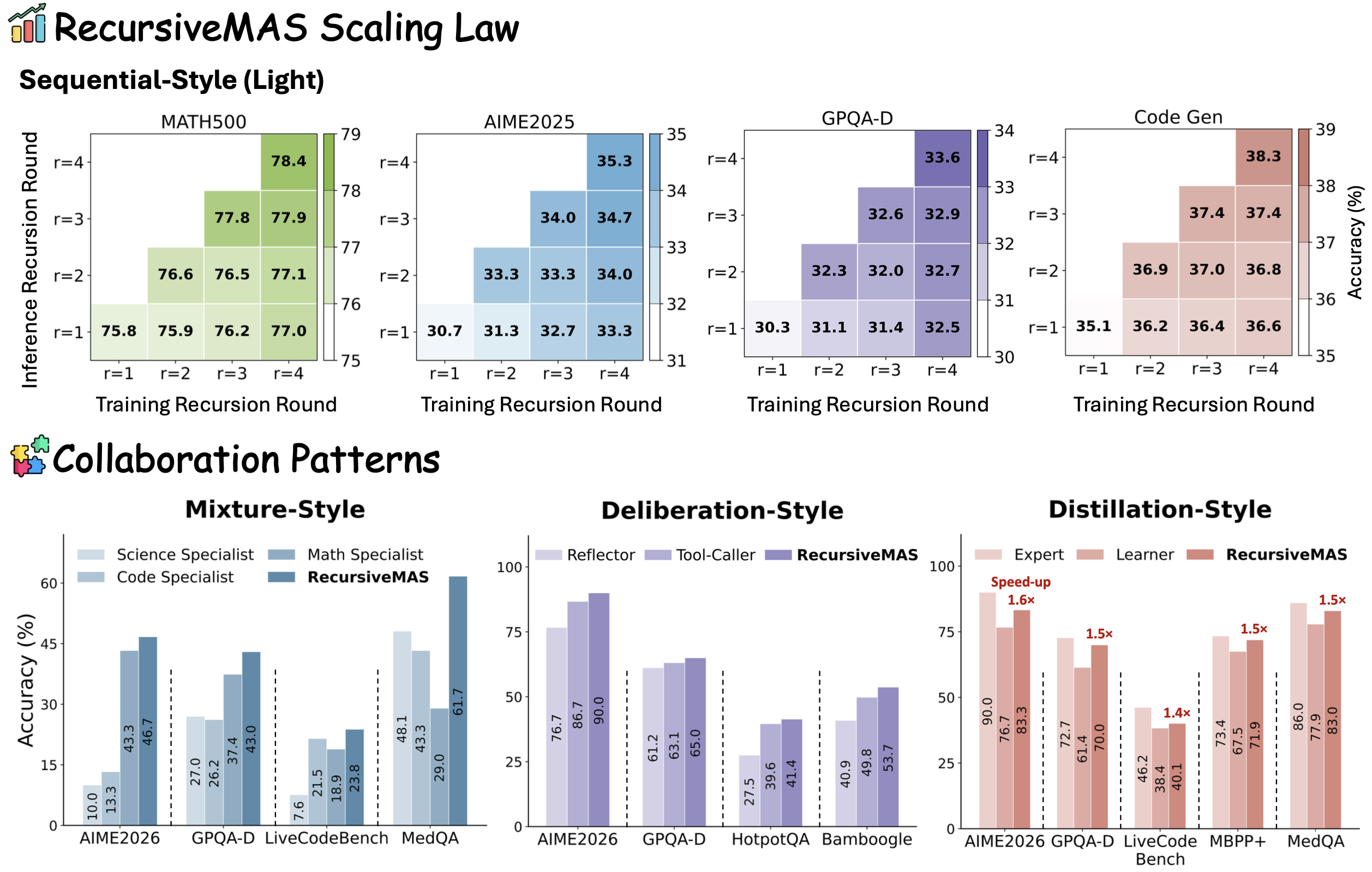

该仓库实现了“递归多智能体系统”,通过潜在空间递归扩展智能体协作能力。提供了多种协作风格、模型检查点和下游推理示例,专注于训练/推理流程的完整实现。

FileToolkit 是一个使用 Python 编写的多功能文件处理工具箱,提供加密解密、编码转换、批量重命名、哈希计算、文件分割合并、备份清理等十余项独立功能。既可作为命令行工具直接使用,也可作为 Python 库集成到其他项目中。

这是一个将Claude Code编程对话自动转化为结构化知识库的工具。通过钩子自动捕获对话记录,使用Claude Agent SDK提取关键决策和经验教训,最终编译成相互关联的知识文章,帮助开发者积累和复用代码知识。无需额外API费用,适合个人在订阅范围内使用。

KWCode是一个专为本地开源模型优化的代码助手CLI工具。它采用专家系统和确定性流水线架构,让能力较弱的小型本地模型(如8B-30B参数规模)专注于分类和生成任务,通过算法压缩上下文、提供智能重试与调试、内置确定性文件与命令工具来实现可用的本地编码代理,注重数据安全与隐私。