该项目使用深度学习技术从图像中的文本识别字体名称。通过生成包含不同字体文本的图像数据集,进行ETL预处理,并训练分类模型来识别字体。包括图像生成工具、数据处理和训练流程。

这是一个字体识别项目,使用ResNet18神经网络模型,能够分析图像并识别其中使用的字体,测试准确率达到95%以上。用户可以通过HuggingFace平台在线体验。

TRIBE v2是一个预测人类大脑对自然刺激(视频、音频、文本)产生功能性磁共振成像(fMRI)响应的多模态深度学习模型。它将先进的文本、音频和视频模型集成到统一的Transformer架构中,用于计算神经科学的研究和实验。

这是一个面向初学者的生成式AI课程仓库,包含21节课的Jupyter Notebook教程,涵盖了从基础到应用的完整学习路径,帮助学习者掌握构建生成式AI应用所需的核心知识和技能。

FinGPT是一个开源金融大语言模型项目,专注于为金融领域提供自然语言处理能力。该项目通过训练并发布HuggingFace模型,支持金融数据分析、对话生成等应用,旨在替代华尔街封闭的LLM方案。

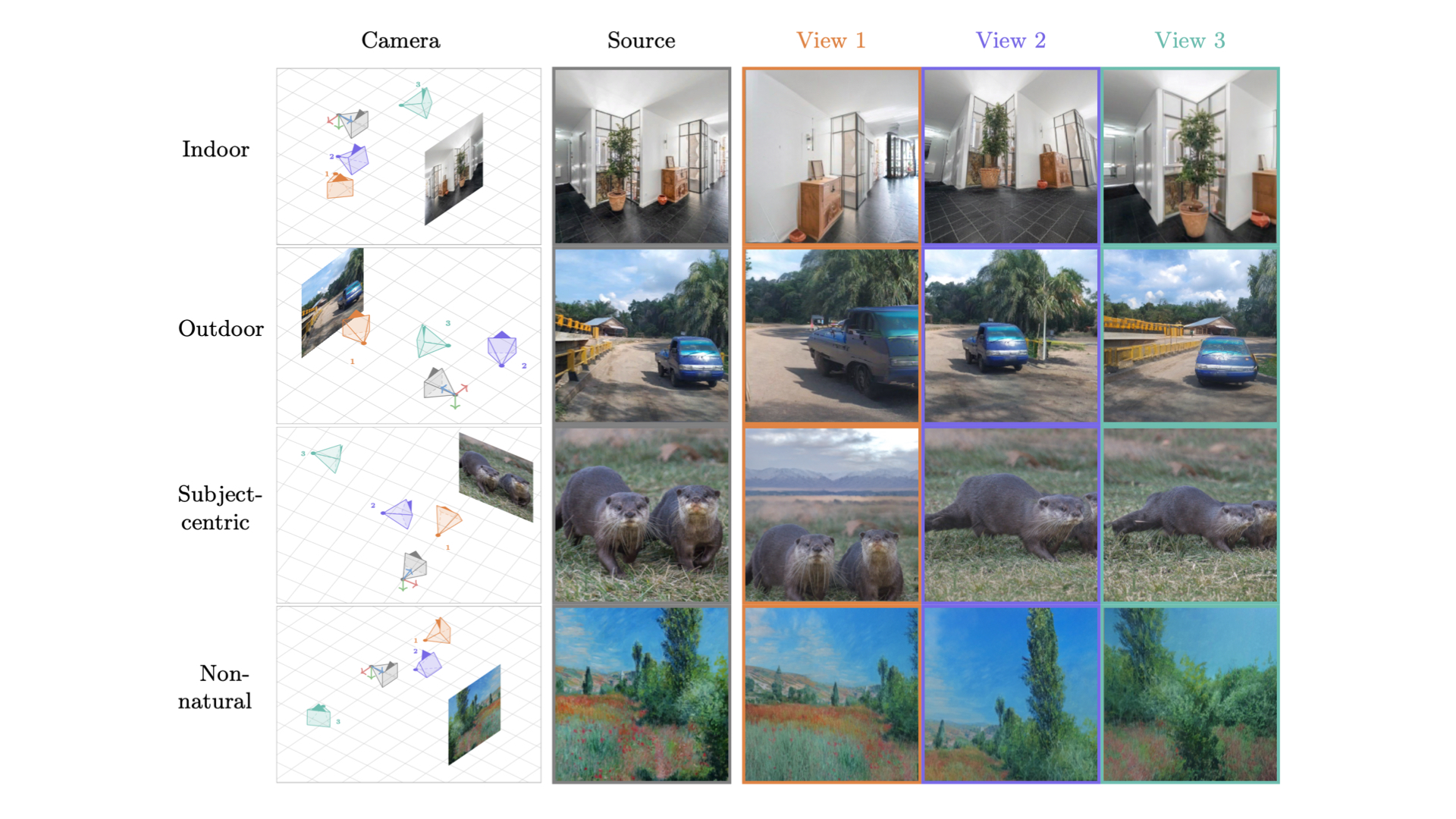

OVIE是一个单目训练框架,仅需单张图像即可生成新颖视角,无需多视角图像对监督,使用未配对的互联网图片进行训练,实现野外场景的新视角合成。

这是一个使用现代C++实现的Peter Shirley光线追踪教程项目,相比原版代码性能提升明显,支持多核渲染,可复现三本书中的所有场景,包含GUI和命令行版本。

AirLLM是一个优化大语言模型推理内存使用的项目,允许70B参数模型在单张4GB显存的GPU上运行,无需量化、蒸馏或剪枝。它支持在资源受限的环境中高效部署和运行大型模型,目前还能在8GB显存上运行405B参数的Llama3.1。

SteerViT是一个框架,可为任何视觉Transformer(ViT)模型添加通过自然语言指令来灵活调控其全局和局部视觉表征的能力。它基于预训练的ViT模型,使用户能够用文本描述指导模型关注特定的视觉特征或区域,增强模型的可解释性和控制性。

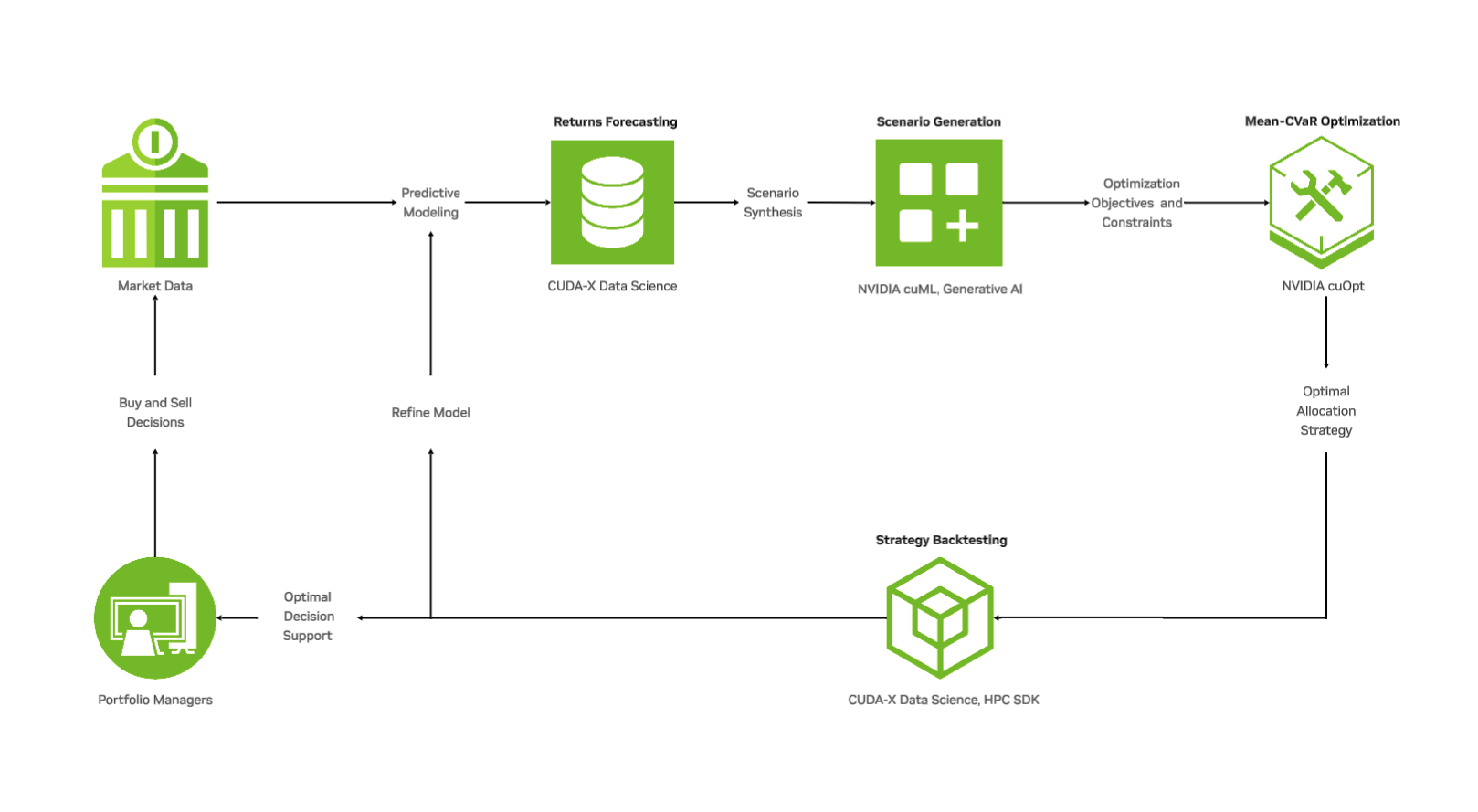

这是一个基于NVIDIA CUDA加速计算的量化投资组合优化开发示例,通过cuDF/cuML加速数据处理和场景生成,使用cuOpt求解器高效解决Mean-CVaR投资组合优化问题,并提供策略回测功能,显著提升计算速度,支持快速迭代的投资决策流程。

GEPA是一个基于遗传算法和帕累托优化的AI框架,专门用于优化文本参数,如提示词、代码、代理架构和配置等。它利用LLM的反思能力进行多目标进化搜索,帮助用户高效改进各类基于文本的系统。

这是一个面向初学者和开发者的LLM微调教程仓库,提供从理论解释、数据处理、模型训练(SFT/RL)到部署的完整端到端流程,基于Jupyter Notebook实现,适合学习与实践。

这是一个专注于上下文学习和提示工程的资源集合库,包含最新论文、实践指南和大型语言模型(如ChatGPT、GPT-3)的使用教程,旨在帮助开发者掌握LLM的提示工程技巧和上下文学习能力,保持与时俱进。

该仓库是ICML 2025论文《Scaling Laws for Upcycling Mixture-of-Experts Language Models》的官方代码库。主要功能是提供数据和Jupyter Notebook分析脚本,用于复现论文中关于混合专家模型从头训练与“升级再造”的扩展律实验与分析。

这是一个基于WebUI的动漫角色图层自动分解工具,可将单张动漫插画自动分解为最多23个图层,支持本地运行且无需编程知识,通过双击安装和启动脚本即可使用。