Kodo是一个AI编码流程编排工具,支持在Claude Code Max订阅中自动运行多代理编码任务。它通过编排层协调多个AI编码代理(如Claude、Cursor、Codex、Gemini等)进行工作循环和独立验证,让用户能够在夜间自动生成经过测试和评审的代码,而不是停留在停滞的终端状态。

CodexSaver是一款MCP工具,通过在Codex和DeepSeek之间进行智能路由来降低AI开发成本。它将低风险的开发任务(如测试、文档、搜索)委托给更经济的DeepSeek模型处理,而让Codex保留对架构设计、安全审查等高价值判断任务的控制。

Cider是一个基于MLX的量化推理框架,专门为苹果M系列芯片(特别是M5及以上)优化。它提供了MLX缺失的在线激活量化算子,通过自定义INT8 TensorCore内核实现W8A8和W4A8量化,可加速LLM推理。包含对mlx_vlm的兼容性补丁,修复多图像推理问题。

这是一个GPT Image 2提示词库与命令行工具,提供162个精选的图像生成提示词示例和可运行的代码片段,可用于研究论文插图、海报设计、UI界面等场景,同时支持智能体技能集成。

这是一个精心整理的顶级开源AI项目列表,涵盖经过实战检验的生产级开源AI模型、核心框架库、推理引擎、AI代理系统、RAG工具、生成式媒体工具以及训练微调基础设施等。旨在为开发者提供高质量的真正开源AI资源参考。

《姚金刚提示词合集》开源版,是一个收集和整理中文AI提示词的资源库。它包含工作、学习、内容、营销和生活等真实场景的116个提示词,为使用AI编写高质量请求提供模板和系统方法。

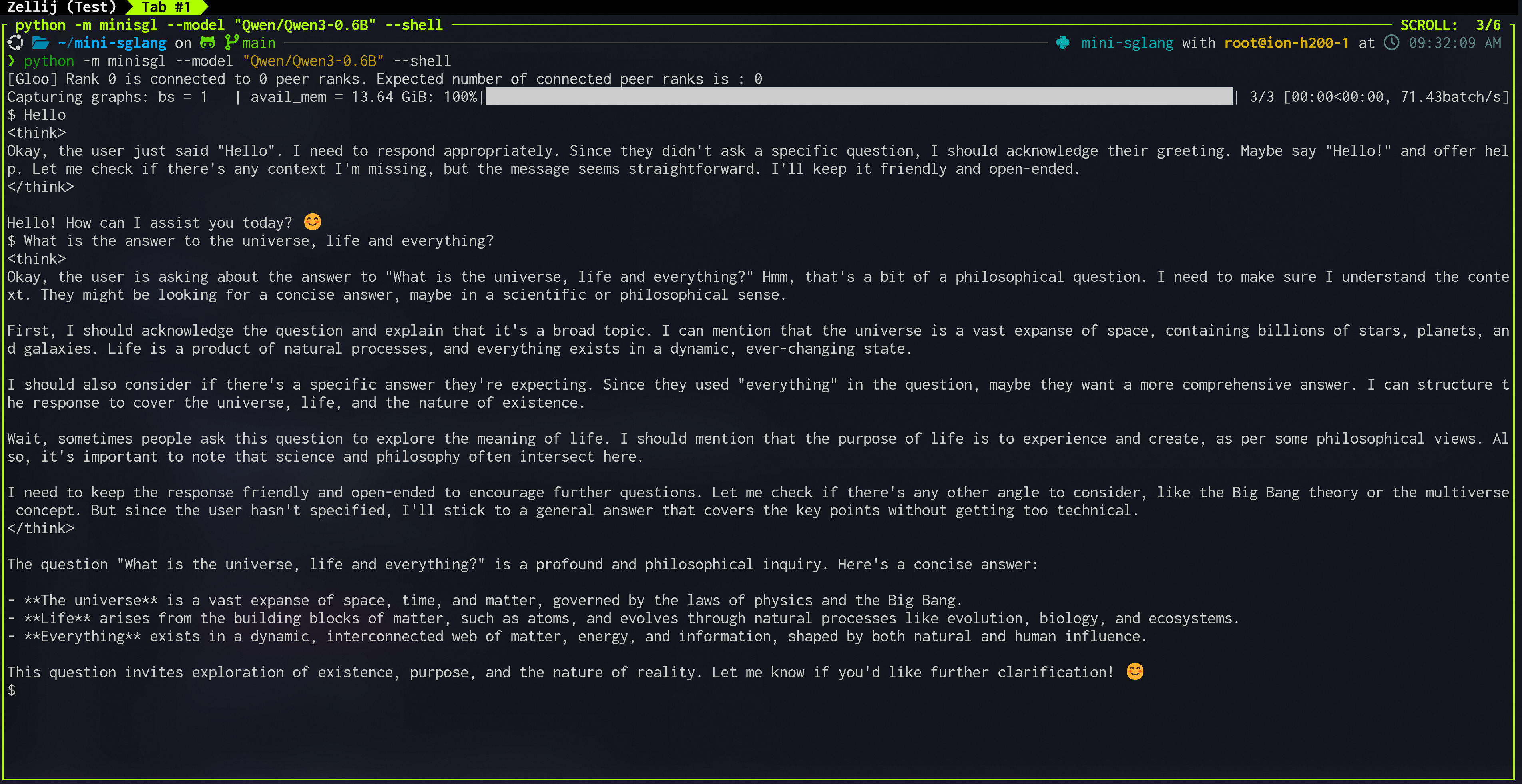

mini-sglang 是一个轻量级高性能的大型语言模型推理框架,通过约5000行Python代码实现,提供先进的优化功能如Radix缓存、张量并行和FlashAttention集成,旨在简化现代LLM服务系统复杂度,适用于研究和开发。

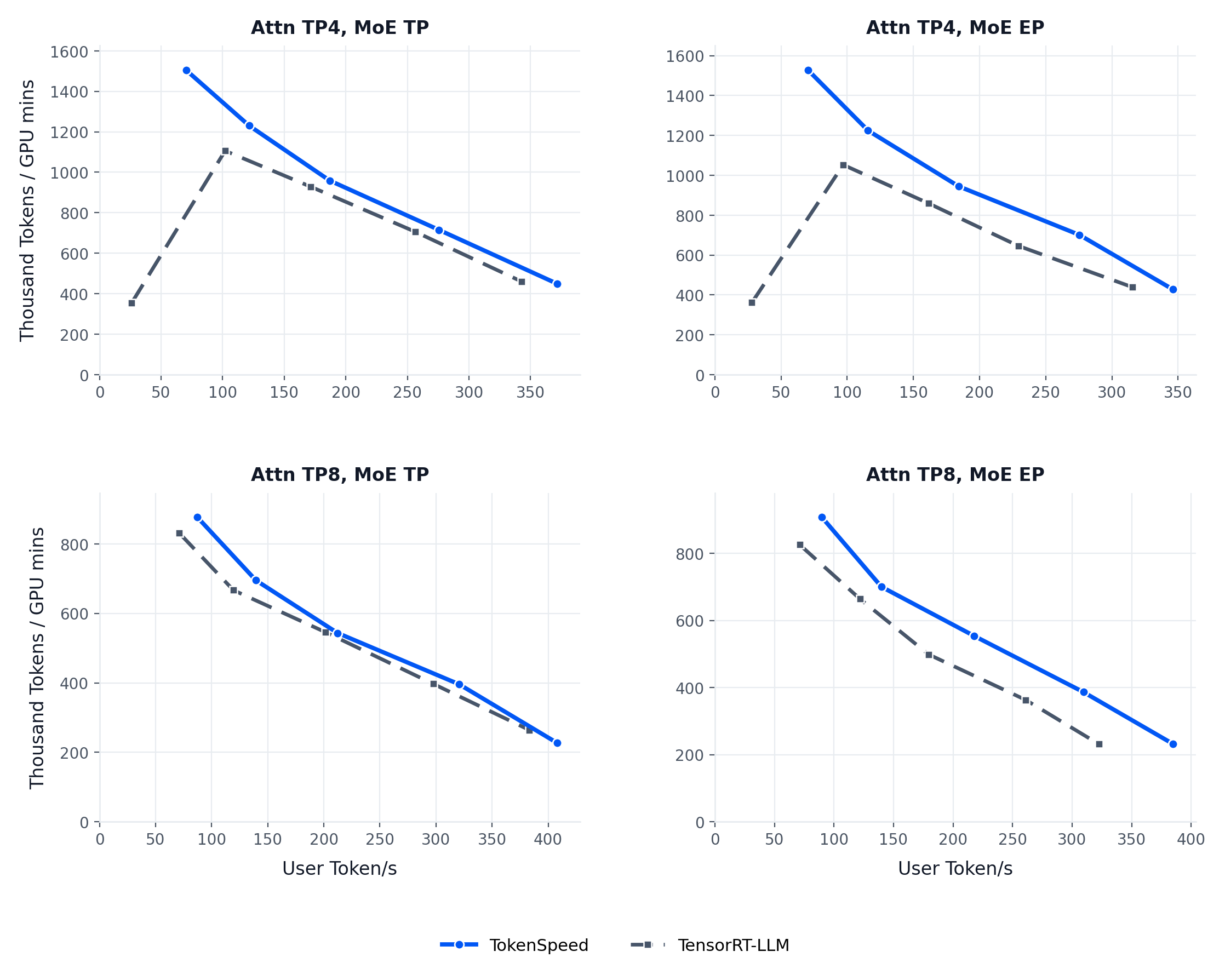

TokenSpeed是一个专为AI agent任务设计的高性能LLM推理引擎,在保证TensorRT-LLM级别性能的同时提供类似vLLM的易用性。它采用本地SPMD架构和静态编译,用户无需手动编写并行逻辑,并通过C++调度器和分层内核系统实现高效推理,尤其针对Blackwell平台优化了MLA(多头潜在注意力)实现。

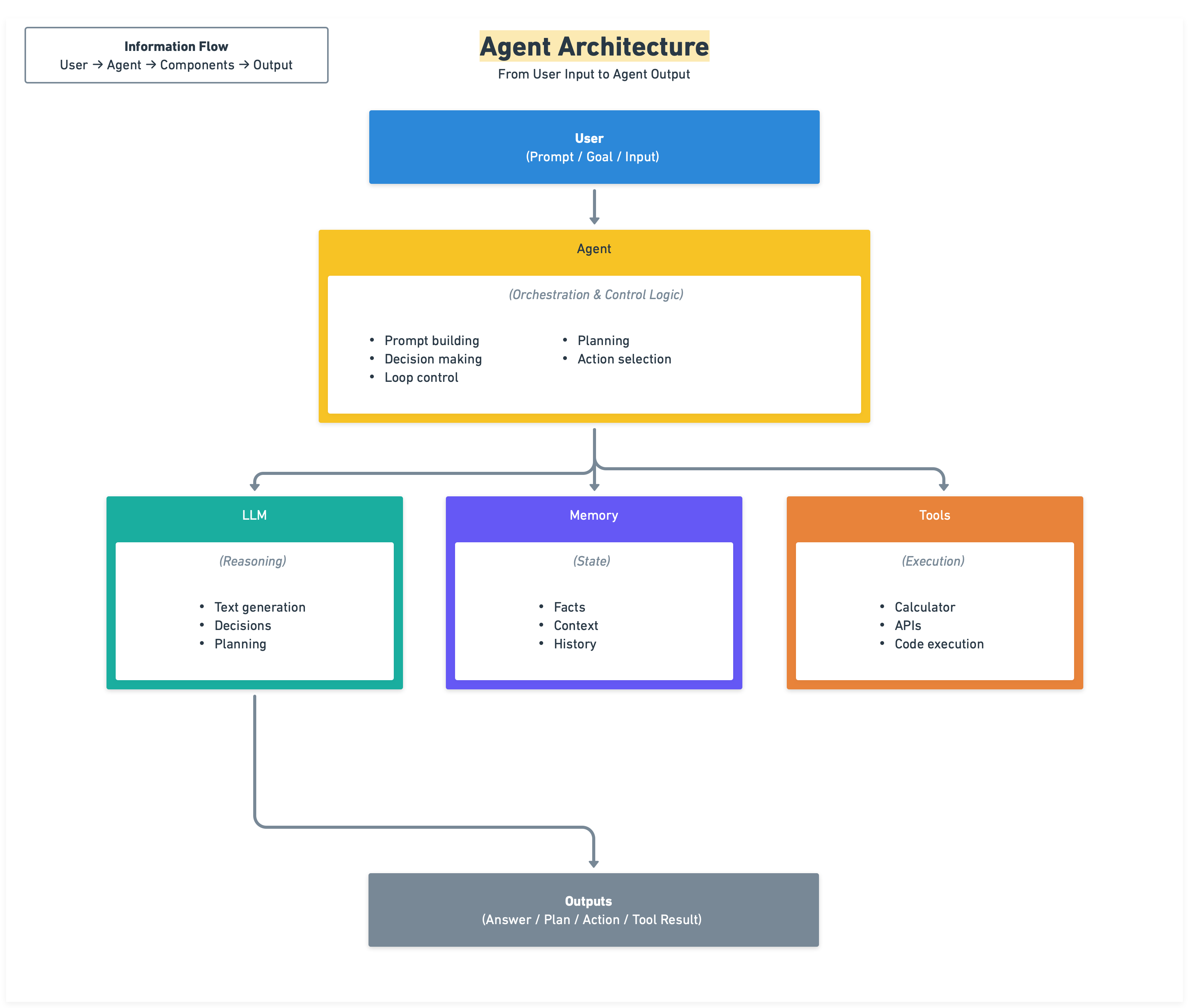

从零开始构建AI智能体的Python教学仓库,通过12个课程逐步教授使用本地LLM开发AI代理的核心原理,涵盖系统提示、结构化输出、决策逻辑和外部工具集成,强调本地化、无框架、无云端API的实践学习。

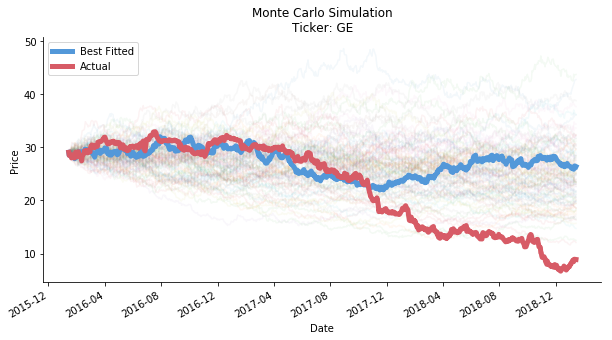

该仓库包含多种Python量化交易策略,包括技术指标自动化交易(如VIX计算、模式识别、RSI、布林带等)、动量交易、统计套利等。主要用于历史数据回测和模拟交易,旨在探索市场异常和生成阿尔法收益。

OMEGA是为AI编码代理设计的本地持久记忆系统,解决跨会话的上下文丢失和重复错误问题。它完全在本地运行,不依赖云端服务,支持多种LLM模型和AI代理工具,避免供应商锁定和数据隐私风险。

Pal是一个个人智能助手,通过构建持续积累的知识库来学习用户的工作方式。它能处理多种数据源(文章、笔记、URL等),自动组织成文本知识库和结构化数据库,并通过Slack、终端或Web界面交互,利用多源查询(数据库、邮件、文件系统等)回答问题,实现学习循环以持续优化。

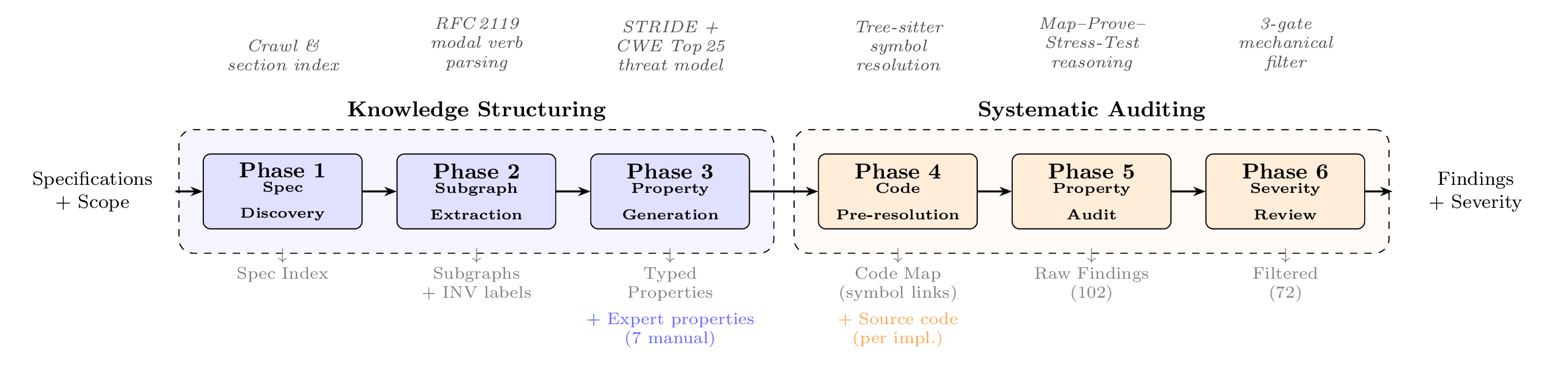

SPECA是一个基于规范的智能审计框架,能将自然语言规范转化为结构化安全检查清单,通过证明尝试推理来发现代码审计工具无法检测的规范级安全漏洞。

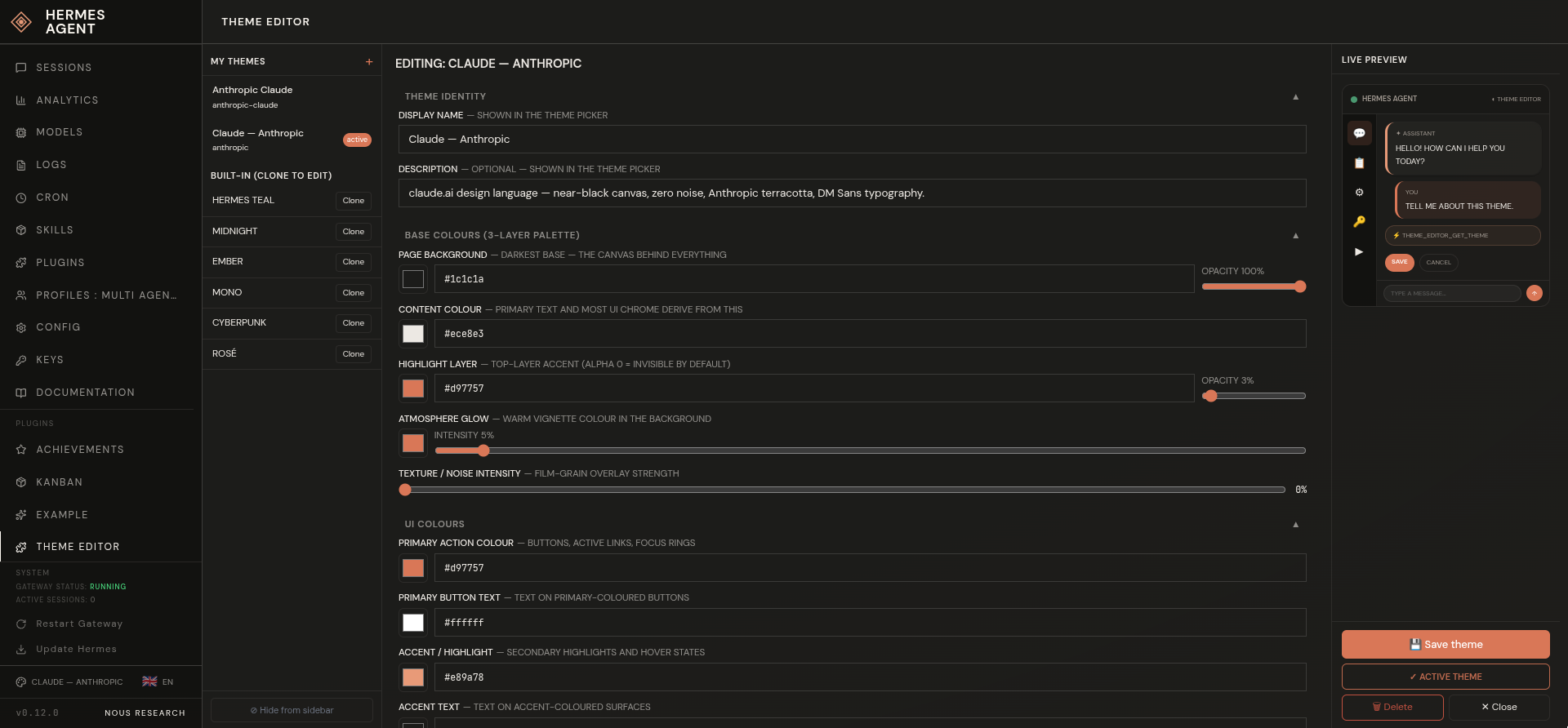

这是一个为Hermes Agent仪表盘设计的可视化主题编辑插件,可在仪表盘内创建、预览和激活自定义YAML主题,无需手动编辑文件。

这是一个Obsidian本地知识库增强工具,使用LLM(如通过Ollama)在本地自动处理Markdown笔记,提取概念并创建或更新相互链接的维基文章。支持用户修正反馈以持续优化知识库,注重隐私,数据完全本地处理。